Y si el cuerpo no fuese el alma, qué es el alma?

Walt Whitman, “Yo canto al cuerpo eléctrico”.

Malabares

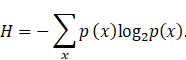

Todo el mundo conoce el rostro de Albert Einstein, su mostacho y su melena de genio, y conoce su ecuación E = mc2. Estoy seguro de que son menos los que conocen el rostro más amable de Claude Shannon, su porte elegante y pulcro, y muchos menos los que tienen noticia de su ecuación:

Y sin embargo la influencia que tienen en nuestras vidas está en proporción inversa a esa popularidad. Solo con la ayuda de algunos estimulantes podríamos sentir que la energía de nuestro cuerpo tendido en el sofá echando la siesta es equivalente a su masa viajando en nuestros sueños a la velocidad de la luz; solo en estados rabiosamente sublimes podríamos sentir la curvatura del tejido espaciotemporal. Pero cada vez están más presentes en nuestras vidas las modernas comunicaciones, desde las analógicas del ya casi obsoleto par de cobre telefónico hasta las digitales que nos permiten acceder a internet desde nuestro teléfono móvil o nuestro ordenador; tan presentes que a nuestra sociedad se le ha llamado de la información, y aunque la denominación sea discutible, las tecnologías de la información y las comunicaciones (TIC) que la configuran han sido posibles gracias a las aportaciones fundamentales de Shannon. Aunque ambas ecuaciones utilicen un mismo lenguaje, sirven a propósitos muy diferentes. La primera es el resultado del esfuerzo por conocer cómo es y cómo funciona la realidad, de encontrar un modelo apropiado para su descripción, y el éxito o el fracaso de ese esfuerzo no cambia lo que es: el mundo en el que vivimos inmersos es el mismo que el que era antes de Einstein. La segunda, por contra, define un modelo realizable y un método de realización, un modelo y un método a partir de los cuales se pueden hacer cosas que aún no existen. La primera pertenece a la ciencia, la segunda a la ingeniería, y cada una es un ejemplo extremo en su clase.

Si se entraba en la casa de Claude Shannon, Entropy House, a las afueras de Boston, donde vivió con su esposa Betty más de treinta años, cada habitación daba al visitante una imagen diferente de sus propietarios. A la empapelada con diplomas y honores recibidos por sus logros como investigador y académico, le sucedía una habitación en la que se podían ver, además de su título de ‘Doctor en malabares’, un montón de mesas llenas de todo tipo de artilugios, unos de colección (una máquina ajedrecista parlante, instrumentos musicales, un saltador motorizado) y otros diseñados y construidos por él mismo (un escenario en miniatura con tres payasos malabaristas, un ratón mecánico que encontraba la salida de un laberinto, o el ordenador Throbac que hacía cálculos en números romanos). Como escribe John Horgan, esta habitación «revela al otro Shannon, al que recorría en monociclo las salas de los Bell Laboratories al tiempo que hacía malabares con cuatro bolas, inventaba un frisbi impulsado por un cohete, y diseñaba una máquina que leía la mente»[93]. Desde niño le habían interesado los artilugios y las matemáticas en igual medida. Enredaba con los aparatos que le proporcionaba su padre y resolvía los rompecabezas matemáticos que le traía su hermana, y su interés era solamente lúdico. Como diría años después, ya adulto y famoso: «Siempre he perseguido mis intereses sin fijarme mucho en su valor financiero o para el mundo. …. He dedicado mucho tiempo a cosas totalmente inútiles»[94]. Dado este interés por las matemáticas y los artilugios, no es de extrañar el que sintió por la criptografía, una técnica para construir artilugios simbólicos. Una de sus historias favoritas era El escarabajo de oro de Edgar Allan Poe. El final de la historia depende de la resolución de un criptograma:

Claude Shannon bien podría decir con Legrand, el personaje del cuento que descifra el mensaje oculto, que las «circunstancias y cierta tendencia personal» le habían llevado a interesarse por ese tipo de enigmas, y como él considerar «muy dudoso que una inteligencia humana sea capaz de crear un enigma de este tipo, que otra inteligencia humana no llegue a resolver si se aplica adecuadamente»[95]. Y no cayó en saco roto la explicación que daba de cómo había llegado a la solución del criptograma siguiendo un método que incluye los siguientes pasos: 1) fijar el lenguaje del mensaje original mediante ensayo, guiado por las probabilidades, de los idiomas conocidos por el investigador; 2) determinar los símbolos y su frecuencia en el mensaje y comparar con las letras del alfabeto en el idioma elegido y su frecuencia de uso; 3) localizar grupos de símbolos y sus repeticiones para hacer con palabras el procedimiento que antes se empleó con letras. Llega así a la conclusión de que el mensaje original es[96] :

Un buen vidrio en el hotel del obispo en la silla del diablo cuarenta y un grados trece minutos y nornordeste tronco principal séptima rama lado este tirad del ojo izquierdo de la cabeza del muerto una línea de abeja del árbol a través del tiro cincuenta pies afuera.

Apostaría a que lo que más interesaba a Shannon de esta historia no era la solución final del enigma, ni le inquietaba el no menos enigmático mensaje descifrado en primera instancia, sino el hecho mismo de poder cifrar o codificar un mensaje de forma que, con una clave y un procedimiento bien definidos, podamos recuperar el mensaje en el lenguaje original, sea el que sea el significado. Y diría más, no creo que le fuera ajena la semejanza de cifrado y ruido, cifrado aleatorio del que se ignora la clave.

Una vez escribió un poema al cubo de Rubik, aquel juguete que se hizo tan famoso en los setenta. Se titulaba Una rúbrica sobre Rubik y sus cúbicas y es más bien una canción, algo ripiosa, para ser cantada con la música de un popular tema de vaudeville (Ta-ra-ra Boom-de-ay), y termina así[97]:

El cambio más cruel de todos,

En insolubilidad.

(Coro) In-sol-u-bilidad.

El lugar más extraño para estar.

Sin embargo persiste

Las soluciones no existen.

El genio de Shannon era único para evitar ese lugar extraño, la ‘insolubilidad’. Según uno de sus estudiantes y posteriormente colaborador, no le interesaban las cuestiones triviales resolubles y evitaba las profundas sin solución para enfocar su esfuerzo y su talento en formular problemas profundos con soluciones realizables. Saltando entre lo serio y lo lúdico, haciendo malabares mientras conducía un monociclo, fue haciendo aportaciones esenciales. Durante la Segunda Guerra Mundial formó parte del equipo que desarrolló SIGSALY (El Avispón Verde, por su zumbido característico mientras funcionaba), el sistema de cifrado que utilizaron Churchill y Roosevelt para sus conferencias transoceánicas privadas, y en 1946 escribió un informe confidencial sobre sistemas de comunicación cifrados, Communication Theory of Secrecy Systems, donde dio una prueba rigurosa de que era posible un esquema de encriptado indescifrable [98]. En 1950 apareció en Scientific American “Una máquina jugadora de ajedrez” con el sugerente subtítulo “Las computadoras electrónicas se pueden configurar para jugar un juego bastante profundo, lo que plantea la pregunta de si pueden «pensar»” [99], artículo en el que enunciaba alguna de las ideas básicas que permitirían a Arthur Samuel cinco años más tarde (cuando ya se disponía de ordenadores capaces) ejecutar el primer programa que hacía posible a una máquina jugar al ajedrez y, en 1959, hablar por primera vez de aprendizaje automático (machine learning) [100]: el establecimiento de un código para representar numéricamente las posiciones y las piezas, la elección de estrategias ponderando cuantitativamente el conocimiento y la experiencia de los maestros de ajedrez y la traducción de la misma a órdenes elementales en un lenguaje que la máquina entienda, un programa para el que establece una estructura funcional jerárquica con un maestro y nueve subprogramas que serían llamados a filas según fueran siendo necesarios; la introducción del azar para no hacer a la máquina predecible, y una vía posible para que la propia máquina mejorase su juego teniendo en cuenta los resultados de las partidas ya jugadas. A la pregunta de si una máquina de este tipo ‘piensa’, responde [101]:

La respuesta depende totalmente de cómo definamos pensar. Puesto que no hay acuerdo general sobre las connotaciones precisas de esta palabra, la pregunta no tiene una respuesta definida. Desde el punto de vista behaviorista, la máquina actúa como si pensara. Siempre se ha considerado que jugar bien al ajedrez requiere la facultad de razonar. Si miramos el pensamiento como una propiedad de las acciones externas más que un método interno, la máquina seguramente piensa.

Reconocemos aquí palabras y argumentos análogos a los que Alan Turing emplea en su artículo publicado en la revista Mind ese mismo año, como lo es la referencia al ‘argumento de Lady Lovelace’: «Por otra parte, la máquina solo hace lo que se le ha dicho que haga». Además, al mirar «el pensamiento como una propiedad de las acciones externas más que un método interno» no está lejos de las consideraciones de Ross Ashby y Grey Walter. Para concluir cita a Leonardo Torres Quevedo, quien en 1914 había hecho, en palabras de Shannon, el primer «intento honesto de diseñar una máquina jugadora de ajedrez»[102]: «Los límites en los que el pensamiento es realmente necesario necesitan definirse mejor … el autómata puede hacer muchas cosas que popularmente se consideran como pensamiento»[103].

Por las contribuciones que hemos comentado y otras que iba repartiendo mientras recorría los pasillos, Claude Shannon ya merecería ser recordado como un inspirador del mundo artificial futuro, pero hizo dos que lo convierten en uno de sus principales inventores.

La lógica y los circuitos

Ese interés compuesto por los artilugios y las matemáticas lo llevaron a graduarse en Matemáticas y en Ingeniería Eléctrica —que en el mundo anglosajón incluye lo que para nosotros es electricidad, electrónica, automática, telecomunicación y, en tiempos de Shannon, el germen de la informática actual— en la Universidad de Michigan y posteriormente, con su Trabajo Fin de Máster en el Instituto Tecnológico de Massachussets, hacer su primera gran aportación y tener su primer gran éxito: A Symbolic Analysis of Relay and Switching Circuits[104]. En este trabajo mostraba cómo el álgebra de Boole podía utilizarse para representar el funcionamiento de los conmutadores y los relés en los circuitos eléctricos y electrónicos cerrando así una vía para un asunto que había ocupado a muchas mentes brillantes durante más de veinticuatro siglos.

En realidad fue Aristóteles en su Organon, con su ordenación, clasificación y sistematización de lo que existe y de las leyes del pensamiento, quien dejó el campo expedito para intentar realizar el proceso de razonamiento mediante procedimientos mecánicos. Las tentativas de Ramon LLull en su Ars Magna a finales del siglo XIII y de Leibniz con su Ars Combinatoria y su Calculus ratiocinator en la segunda mitad del siglo XVII fueron prematuras, pero George Boole en An Investigation of the Laws of Thought on Which are Founded the Mathematical Theories of Logic and Probabilities, de 1854, pudo desarrollar un sistema de reglas que permitían expresar, manipular y simplificar problemas lógicos y filosóficos cuyos argumentos admiten dos estados (verdadero o falso) por procedimientos matemáticos. Para llegar al fin práctico, solo hacía falta un solucionador de problemas como Shannon, quien de forma característica quitó importancia a la que ha llegado a llamarse «posiblemente la tesis [de máster] más importante del siglo [XX]»[105] diciendo:

Lo que ha pasado es que nadie más estaba familiarizado con ambos campos [la lógica y los circuitos] al mismo tiempo. …. Siempre me ha gustado la palabra ‘Boolean’.

Para tener una idea de como Shannon dio una realización práctica a la characteristica universalis de Leibniz, ese lenguaje universal y formal capaz de expresar conceptos matemáticos, científicos y metafísicos susceptible de ser usado en su Calculus ratiocinator, y con el cual «todas las verdades de razón podrían reducirse a un cálculo»[106], es mejor citarlo por extenso que parafrasearlo haciendo una aclaración previa: hemos de pensar en relés y conmutadores como puentes que están habilitados o no para poder pasar de una porción de tierra a otra, y realizar así uno u otro recorrido. Shannon introduce su trabajo de la siguiente forma:

Aquí trataremos dos problemas que surgen en esas redes de conmutadores. El primero, que llamaremos análisis, es determinar las características operativas de un determinado circuito. …. El segundo problema es el de síntesis. Dadas ciertas características [funcionales], se requiere encontrar un circuito que las incorpore. […] cada circuito se representa por un conjunto de ecuaciones, correspondiendo cada uno de sus términos a los relés y conmutadores del circuito. Se desarrolla un cálculo para manipular esas ecuaciones por un procedimiento matemático simple, en su mayor parte similar a los algoritmos del álgebra ordinaria. Se muestra que este cálculo es exactamente análogo al Cálculo de Proposiciones utilizado en el estudio simbólico de la lógica. Para el problema de síntesis, primero las características deseadas se escriben como un sistema de ecuaciones, y después las ecuaciones de forma que representen al circuito más simple. El circuito puede obtenerse de las ecuaciones.

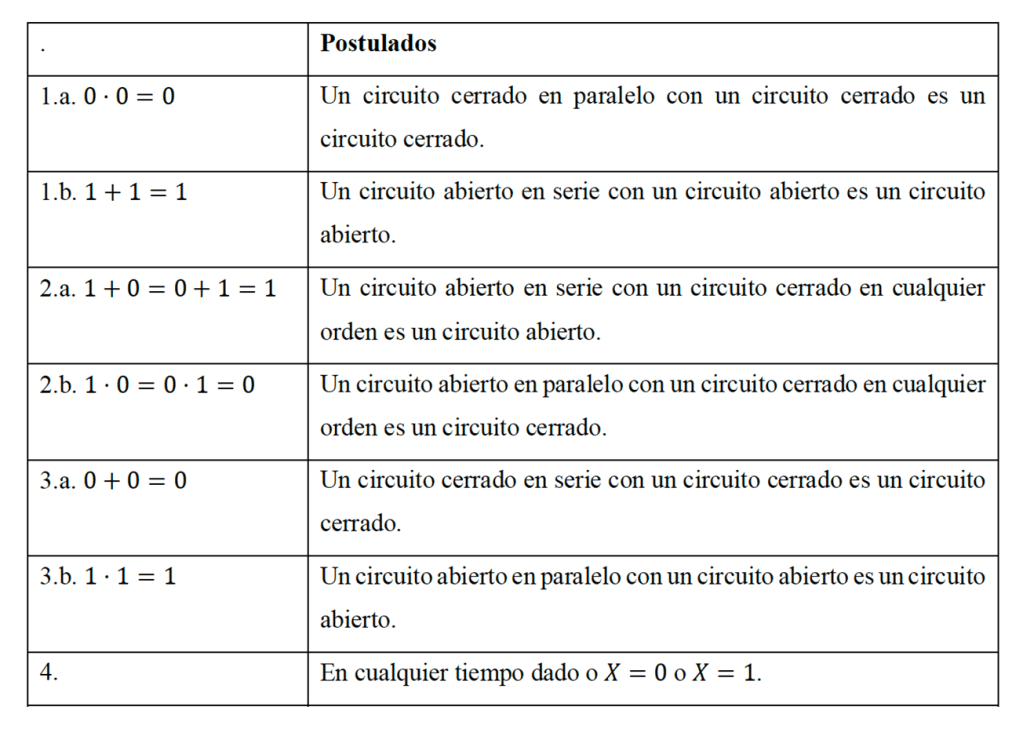

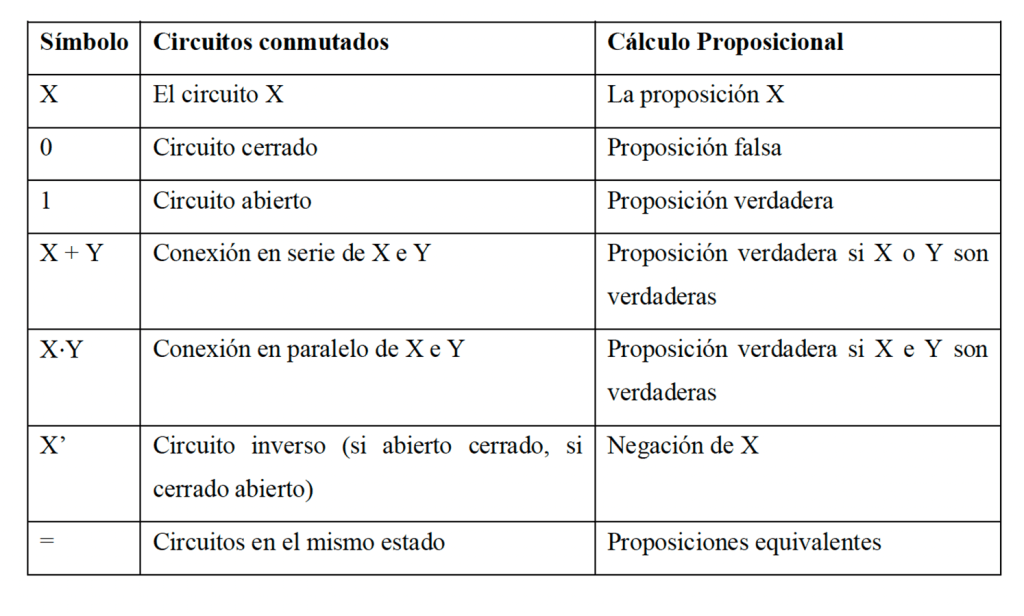

Al considerar solo relés y conmutadores, en un momento determinado el circuito entre dos terminales solo podía estar abierto (sin conexión o continuidad, representando una oposición, o impedancia, infinita o total al paso de la corriente) o cerrado (conectado o con continuidad, representando la falta total de oposición al paso de la corriente). Utilizó el símbolo 0 (cero) para el caso del circuito cerrado, y el símbolo 1 para el abierto; el “+” para significar la conexión en serie y el “ . ” para la conexión en paralelo. Así, la base de todo el método podía quedar resumida en los postulados de la tabla 3.1, y su analogía con el Cálculo Proposicional es la que se detalla en la tabla 3.2. De esta forma, el joven estudiante de veintidós años hizo posible que los diseños de circuitos pudieran probarse y verificar su funcionamiento sin necesidad de ser construidos, y abrió el camino para el uso del álgebra en el diseño de hardware y software de ordenadores, teléfonos y redes telefónicas, y todo aquello que tenga que ver con el mundo digital. Y lo que es más importante para nuestro estudio: había mostrado cómo una máquina, por su mera estructura física, podía ‘razonar’, demostrar la validez de cualquier argumento, lo mismo que Turing había mostrado la posibilidad formal de una máquina capaz de ‘calcular’ cualquier número.

La teoría de la información

Los elementos de la comunicación

El problema fundamental de la comunicación es el de reproducir en un punto, de forma exacta o aproximada, un mensaje seleccionado en otro punto. Frecuentemente los mensajes tienen significado; esto es, se refieren a o están correlacionados de acuerdo con algún sistema con ciertas entidades físicas o conceptuales. Estos aspectos semánticos de la comunicación son irrelevantes para el problema de ingeniería. El aspecto significativo es que el mensaje considerado es uno seleccionado de un conjunto de posibles mensajes. El sistema se debe diseñar para que opere para cada selección posible, no solo para el que hemos considerado porque éste es desconocido en el momento del diseño. (Claude E. Shannon, Una teoría matemática de la comunicación [107].)

He traducido aquí el segundo párrafo del trabajo de Shannon que desde el principio deja claro cuál es el problema que pretende haber resuelto y qué aspectos y connotaciones de los términos información y comunicación no le incumben en su ‘problema de ingeniería’, como Alan Turing se apresuró a restringir los significados de ‘pensar’ y ‘máquina’ para exponer sus consideraciones sobre la posibilidad de inteligencia en las máquinas.

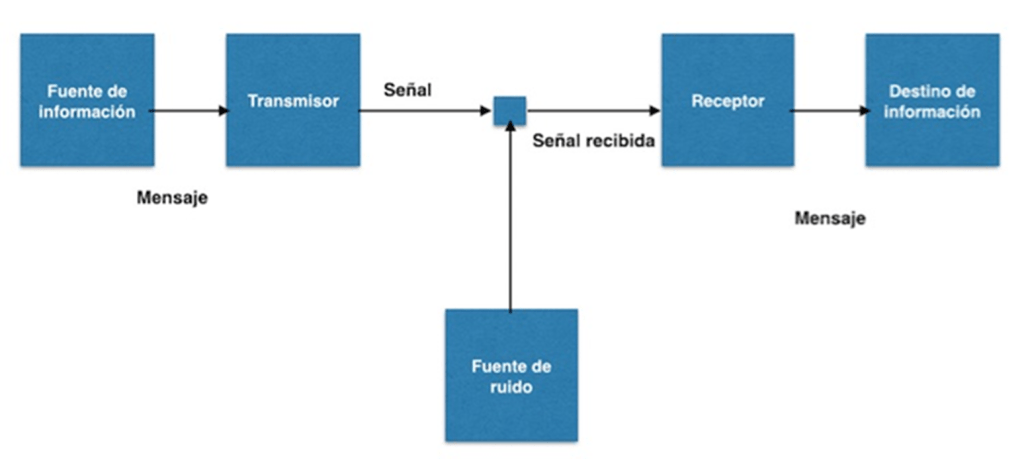

El sistema de comunicación considerado por Shannon es como el que se muestra en la figura 3.1. Está compuesto por una fuente de información que produce el mensaje o la secuencia de mensajes que han de ser comunicados; un transmisor que opera sobre el mensaje con objeto de producir una señal que se pueda transmitir sobre el canal, el medio utilizado para realizar la transmisión que, generalmente, está afectado por ruido; el receptor que realiza la operación inversa de la efectuada por el transmisor reconstruyendo el mensaje a partir de la señal recibida, y el destinatario del mensaje, sea éste persona o cosa. Como muestra de la universalidad del esquema de Shannon daremos el siguiente ejemplo[108]. Algunas de las vacunas contra la Covid-19, las más ’modernas’, están basadas en el denominado ARN mensajero. El ARN mensajero o ARNm es el ácido ribonucleico que transfiere el código genético procedente del ADN del núcleo celular a un ribosoma en el citoplasma, es decir, el que determina el orden en que se unirán los aminoácidos de una proteína y actúa como plantilla o patrón para la síntesis de dicha proteína. Según el diagrama de Shannon, su funcionamiento se puede sintetizar así: en la célula, una hebra de ADN contiene las instrucciones para fabricar una proteína (fuente); las instrucciones se codifican en una tira de ARNm (transmisor); el ARNm lleva el código a los lugares de las células que se encargan de la síntesis de proteínas (canal); uno de los símbolos en el código cambia aleatoriamente produciendo una mutación (ruido); cada paquete de tres símbolos se traduce en un aminoácido, bloque básico de las proteínas (receptor); los aminoácidos se enlazan en una cadena proteínica, con lo que el mensaje original ha sido recibido (destinatario).

Para terminar de establecer las bases de su estudio, Shannon clasifica los sistemas de comunicación en tres categorías: discretos, continuos y mixtos. Los discretos son aquellos en los que tanto el mensaje como la señal son secuencias de un conjunto finito de símbolos: el sistema telegráfico transmitía el contenido de un texto (secuencia de letras) mediante una señal que era una secuencia de puntos, rayas y espacios. Los sistemas continuos son los que tratan mensajes y señales que varían de forma continua: en tiempos de Shannon, el teléfono, la radio o la televisión. Los sistemas mixtos conjugan los dos tipos anteriores. Hoy en día casi han desaparecido los sistemas continuos, pues aunque los mensajes sean continuos las señales que se transmiten son digitales. Nosotros, en lo que sigue y con objeto de tener un vislumbre de la aportación de Shannon, vamos a enfocar la parte central de nuestro esquema, el camino que sigue la señal entre transmisor y receptor. Pero primero debemos mirar un poco atrás para ver cómo era la información antes de Shannon.

La información antes de Shannon

En 1924, H. Nyquist, un joven sueco que trabajaba en los Laboratorios Bell, presentó en un congreso de ingenieros eléctricos celebrado en Filadelfia un trabajo titulado “Ciertos factores que afectan a la velocidad del telégrafo”[109]. Como hemos dicho, el telégrafo transmitía puntos y rayas, señales discretas (encendido o apagado); el teléfono por el contrario trasmitía conversaciones, señales de voz que, por supuesto, eran continuas (podían tener cualquier valor dentro de un rango); y Nyquist pensó que, para aprovechar mejor la capacidad de la línea, las señales telegráficas se podían ver como un caso particular de las telefónicas, y que, por tanto, las telefónicas se podían ‘descomponer’ en señales discretas como las primeras transmitiendo solo el código correspondiente al ‘valor’ de la señal en ese instante, su ‘muestra’. Llegó a la conclusión de que

La velocidad a la cual la «inteligencia» [información] puede transmitirse sobre un circuito telegráfico con una velocidad de línea dada, i.e., a una velocidad dada de envío de los elementos de la señal [entiéndase símbolos del código] puede determinarse aproximadamente por la fórmula ….

W=K log (m)

donde W es la velocidad de transmisión de inteligencia, m el número de valores de corriente [símbolos en el código], y K una constante. … Por velocidad de transmisión de inteligencia se entiende el número de caracteres, representando diferentes letras, figuras, etc., que pueden transmitirse en un intervalo de tiempo dado asumiendo que el circuito transmite un número dado de elementos de señal por unidad de tiempo.

Tres años más tarde, Ralph Hartley, colega de Nyquist, en un congreso celebrado a orillas del lago de Como, de tantas resonancias históricas y literarias, presentó una comunicación que, continuando los trabajos de Nyquist, serviría de puente para el desarrollado por Shannon veinte años después: cambia el término ‘inteligencia’ por el de ‘información’ y da una definición y una medida cuantitativa de dicho término, una medida basada en consideraciones «físicas en contraste con las sicológicas»[110]. De esta forma, llegó a la conclusión de que la cantidad de información respondía a la fórmula:

H= n log (s)

donde s es el número de símbolos posibles en el alfabeto y n el número de símbolos transmitidos (escogidos). Así, propone H como medida de la cantidad de información transmitida, siendo esta medida el logaritmo del número de secuencias de n símbolos de los s disponibles en el alfabeto.

Claramente se pueden observar en los dos artículos las dificultades con la terminología; además, el tema tratado no era muy interesante para las revistas científicas. Pero los laboratorios Bell tenían su propia revista y sus propios intereses, y cuando Claude Shannon llegó allí en 1941 y los leyó con atención, supo de inmediato que tenía que terminar el trabajo.

Códigos

En el capítulo introductorio hablamos de las máquinas modernas como dispositivos capaces de procesar información. Ahora, como hizo Turing, restringiremos el concepto de máquinas a los ordenadores digitales, y ello nos obliga a hacer lo propio con el concepto de información [111].

Si lo que estoy contando no supone para el lector ninguna novedad, puede que nos estemos comunicando, pero no le estoy transmitiendo información. Si tiramos al aire una moneda trucada, una moneda con dos caras, ya sabemos previamente lo que va a salir pues no hay alternativas, y el experimento carece de sentido; sin incertidumbre no hay información. Supongamos ahora que la moneda está trucada de tal forma que, en promedio, de cada 10 veces que la lanzamos 2 sale cruz (X) y 8 cara (C). Supongan que lanzamos la moneda 20 veces y el resultado es: CCCXCCCCCCXCCCCCCCCC. En lugar de C y X, puesto que las posibilidades son solo dos, codificaremos cara como 0 y cruz como 1. Así, el resultado de nuestro experimento quedaría representado por el código binario: 00010000001000000000. Puesto que la alternativa cruz (1) es mucho menos probable que la alternativa cara (0), podemos intentar un código más corto, que utilice menos caracteres, y que nos dé la misma información sobre el resultado del experimento. Agrupemos los resultados de dos en dos: CC CX CC CC CC XC CC CC CC CC; y codifiquemos las parejas de resultados consecutivos en lugar de los resultados individuales de la forma que a la combinación CC le hagamos corresponder el código 0, a XC el 10, a CX el 110 y a XX el 111. Así, como cara es el resultado más probable, utilizaremos para el caso de dos caras seguidas solo un carácter de nuestro alfabeto binario en lugar de dos. Con la asignación anterior, el código que representa el resultado de nuestro experimento sería: 0 110 0 0 0 10 0 0 0 0. Este código solo requiere trece símbolos para representar el resultado del experimento, es decir, para transmitir la misma información, en lugar de veinte: diremos que el último código es más eficiente. También hay símbolos superfluos en muchas de nuestras conversaciones habituales, y frecuentemente los eliminamos cuando éstas se llevan a cabo de forma escrita. Por ejemplo, en lugar de escribir «Espero que te encuentres bien. Un abrazo» escribimos, sin temor a que no nos entiendan «Espero q te encuentres bien. Un abrz».

La medida de la información

Si nuestra moneda no estuviera trucada, si la probabilidad de que saliera cara fuera igual a la de que saliera cruz, si la incertidumbre fuera máxima, el experimento nos aportaría, en promedio (salga cara o salga cruz), la máxima cantidad de información. De acuerdo con esto se puede buscar una fórmula para cuantificar la cantidad de información que nos aporta un lanzamiento en función de la probabilidad de cada resultado, una fórmula que debería cumplir que cuanto menor sea ésta (la probabilidad) mayor sea aquélla (la cantidad de información), de igual forma que el lector habrá recibido más información cuantas más cosas nuevas haya conseguido transmitirle. Puesto que son dos alternativas, 0 y 1, el número 2 debería jugar en nuestra fórmula un papel básico.

Aunque la costumbre hace que no seamos conscientes de ello, cuando escribimos el número 345 estamos significando una cantidad que es 3 x 10 x 10 + 4 x 10 + 5 x 1, es decir, una cantidad que se obtiene multiplicando cada cifra por 10 tantas veces como posiciones nos desplacemos a la izquierda a partir de la de menos peso, la menos significativa. Y es así porque para la numeración que utilizamos cotidianamente la base es 10, decimal. Utilizar el sistema decimal supone que disponemos de diez símbolos diferentes: 0, 1, 2, 3, 4, 5, 6, 7, 8, 9. Cuando queremos indicar una cantidad mayor que 9, necesitamos hacer uso de más cifras para construir el número que signifique dicha cantidad, por ejemplo 10. Si utilizásemos otra base, por ejemplo 6, los símbolos disponibles serían 0, 1, 2, 3, 4, y 5, y con las cifras anteriores obtendríamos el número 3 x 6 x 6 + 4 x 6 + 5 = 137 en base 10. Si tenemos, como en el caso de las monedas, solo dos alternativas, y los símbolos disponibles son 0 y 1, parece lógico utilizar el 2 como base. Así que para una cantidad superior a 1 necesitaremos dos o más cifras. Por ejemplo, el número 10 en binario será el 1 x 2 + 0 = 2 en base 10, y el 110 equivaldrá al 1 x 2 x 2 + 1 x 2 + 0 = 6 en base 10. De esta forma, si formamos números de n cifras con solo 2 símbolos diferentes, 0 y 1, podremos significar cantidades que vayan desde 0 hasta 2 x 2 x 2 x 2 … n veces … x 2 -1, lo cual implica que podemos tener 2 x 2 x 2 x 2 … n veces … x 2 números diferentes. Convendremos, para simplificar, que el anterior producto de n doses lo podemos indicar como 2n . Así con 8 cifras podremos representar desde el 0 al 28 -1, 256 combinaciones diferentes, y llamaremos a 8 el logaritmo en base 2 de 256: log2(256) = 8.

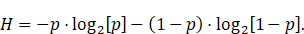

La medida de la información propuesta por Shannon se fundamenta en dos observaciones principales: la conveniencia de utilizar el sistema binario para transmitir información y la incertidumbre como vara de medir. Tomando como unidad básica de información la unidad binaria, el bit (binary unit), como mensaje que representa un estado de dos igualmente probables, y buscando la forma de que cuanto menor sea la probabilidad mayor sea la cantidad de información, llegó a la conclusión de que el resultado cara (el de probabilidad 0.8) aportaba una información de log2 (0.8) = 0.3219 bits, y el resultado cruz, de probabilidad 0.2, -log2 (0.2) = 2.3219 bits, y en promedio un lanzamiento de la moneda aportará -0.8⋅log2 (0.8)-0.2⋅log2 (0.2) = 0.7219 bits. En el caso de que la moneda sea fiable obtendremos -0.5⋅log2 (0.5)-0.5⋅log2 (0.5) = 1 bit de información, la máxima cantidad de información que puede aportar 1 lanzamiento de la moneda. Generalizando para dos símbolos con probabilidades p y q = 1 – p , se obtiene como expresión para cuantificar la información la siguiente:

cuya generalización es la fórmula con la que abrimos este capítulo. En la figura 3.2 vemos una gráfica en la que se representa la función H cuando p varía entre 0 y 1. Como podemos observar, la máxima información se obtiene cuando ambos símbolos tienen la misma probabilidad.

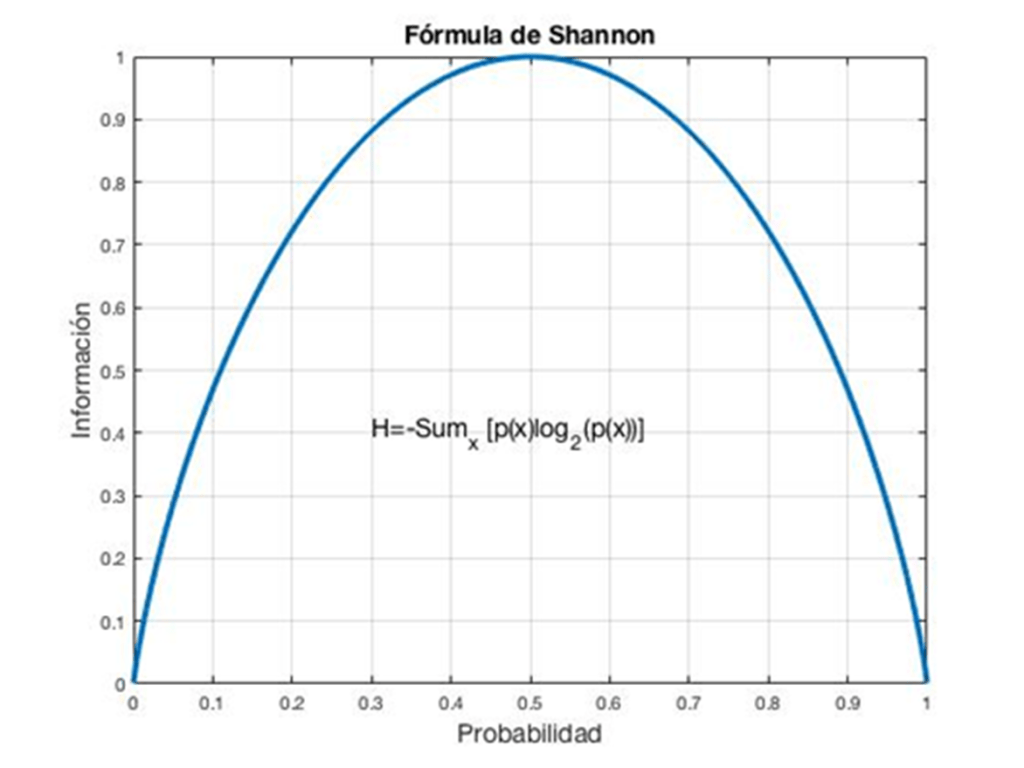

Si considerásemos un alfabeto de n símbolos, todos ellos con la misma probabilidad, obtendríamos para H una evolución como la representada en la figura 3.3. Ésta es siempre una curva de máximos: nos dice la cantidad máxima de información medida en bits que podemos obtener, en promedio, con n símbolos, o tirando n veces la moneda, y ningún código que empleemos podrá hacer que obtengamos más.

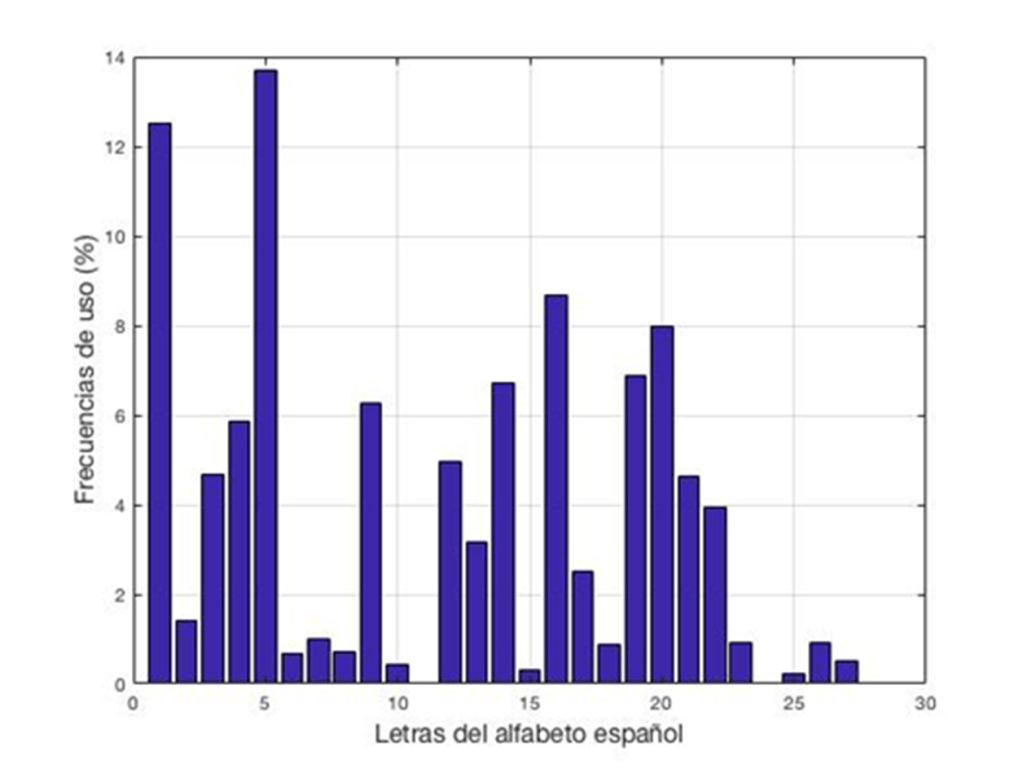

En general, para cualquier número de símbolos en el alfabeto y para cualesquiera probabilidades, aplicaríamos la expresión general para calcular la cantidad de información promedio. En la figura anterior, el asterisco señalaba el valor de H para el alfabeto español según la frecuencia de uso de las distintas letras, representada en la figura 3.4. En ella podemos ver que si, en un juego de adivinar palabras, nos dan como pista que contiene la letra a y la letra e, nos han dado poca información puesto que se utilizan con mucha frecuencia (12,53% y 13,68% respectivamente). Sin embargo, si nos dicen que la palabra contiene las letras k (0,02%) y w (0,01%), podemos arriesgarnos a decir kiwi.

Shannon denominó a la magnitud H entropía, como a la magnitud utilizada en termodinámica para dar una medida del desorden en un sistema, y parece que fue la estructura matemática de la fórmula que había obtenido la que indujo a John von Neumann a sugerírselo: el hecho de que nadie sepa qué es realmente la entropía, arguyó von Neumann, le daría a Shannon una ventaja en los debates sobre teoría de la información[112]. Sin embargo, no sería extraño que von Neumann sacara la idea directamente de su colega y compatriota Leo Szilárd, que en 1929 había publicado “On the decrease of entropy in a thermodynamic system by the intervention of intelligent beings”, trabajo en el que establecía una conexión entre el incremento de entropía (o desorden) y el incremento de información (orden) que resulta de una medida, al tiempo que anticipaba el concepto de la unidad básica de información o bit[113]. Pero la entropía de Shannon es una medida de la incertidumbre, de la aleatoriedad, que solo metafóricamente podemos equiparar al desorden en un sistema. La entropía de Shannon existe en el mundo artificial, en su modelo y en los que de él se derivan, y esto, que se podría ver como una limitación, hace que su definición sea completa, consistente y sin incertidumbres: el escenario está diseñado, y sus posibilidades son finitas y distintas.

El ruido y los errores

En un escenario real, la señal que se transmite se ve perturbada de formas diversas, lo que significa que la señal recibida por el receptor no es la misma que el transmisor confió al canal y por tanto, si no ponemos remedio, el mensaje recibido por el destinatario no es el mismo que produjo la fuente. Por ejemplo, podríamos escribir «perdón» y el destinatario recibir «pendón», y esto sin la contribución del corrector ortográfico que tantas bromas nos gasta, sino por el mero hecho de que algo en su recorrido ha perturbado la señal. Llamaremos a ese algo ruido, porque no lo deseamos y porque nos impide recibir en su integridad aquello que estamos esperando. Y lo que es más importante, porque es una perturbación aleatoria, azarosa. Así, la señal que recibimos es siempre una combinación siempre nueva de la señal transmitida y del ruido. Siguiendo su enfoque probabilístico, Shannon cuantificó el ruido como una probabilidad de error en la cadena de símbolos recibida, cuya entropía sería ahora diferente a la de la cadena transmitida.

El ruido se podría reducir con un mejor diseño y fabricación de los equipos, pero aún nos quedarían las fuentes principales: las perturbaciones y las limitaciones del canal. Podríamos utilizar un código de detección de errores muy simple, como sería enviar el mensaje dos veces. Si el destinatario recibe primero «pendón» y después «perdón» puede deducir que hay un error en la tercera letra siempre que hayamos acordado que vamos a intercambiar palabras y que las vamos a enviar dos veces para detectar posibles errores, pero aún así no podría saber cuál de las palabras recibidas es la correcta. O podríamos utilizar el código de los esquimales del labrador y transmitir «no ser capaz de pensar en ello nunca más» para significar «perdón»[114]. Una tercera repetición nos permitiría decidir cuál de los mensajes recibidos es el correcto, nos permitiría corregir el error. Estos códigos reemplazan el mensaje original por uno más largo (el doble o el triple en el caso de la simple repetición), y esto conlleva más tiempo de transmisión y un coste superior en términos de memoria, dinero y ocupación del canal, de forma que se hace imprescindible utilizar códigos de detección y corrección de errores eficientes, códigos que permitan que la proporción entre la longitud del mensaje codificado y la del original sea menor.

A partir de estos conceptos mencionados, Shannon determinó cómo hallar la capacidad de un canal, dio las pautas para poder detectar y corregir los errores introducidos por el ruido o por las deficiencias del canal, o mejor, por la combinación de ambos factores, y fijó los criterios para conocer las relaciones cuantitativas entre capacidad de un canal, entropía o cantidad de información, y eficiencia de la codificación.

Después de Shannon

Cuando vamos corriendo por el parque a la orilla del río, con el móvil fijado al brazo y los auriculares puestos, disfrutando de la naturaleza y de la música que escuchamos limpia y continua, como si naciera en nuestro oído; cuando enviamos un whatsapp a un amigo y éste lo recibe como si fuera un secreto entre ambos, de forma privada, estamos en deuda con Shannon. Su teoría de la información juega un papel importante en el análisis de la secuencia del ADN, esa doble hélice en la que cada hebra está construida por una secuencia de bases (adenina, guanina, timina y citosina) como un mensaje codificado escrito con esos cuatro símbolos (A, G, T, C), un mensaje que encierra buena parte de lo que fuimos, somos y seremos. Como se dice en una reciente biografía [115],

Por supuesto, la información existía antes de Shannon, como los objetos tenían inercia antes de Newton. Pero antes de Shannon, era escaso el sentido de la información como una idea, una cantidad medible, un objeto preparado para la ciencia dura. Antes de Shannon, la información era un telegrama, una fotografía, un párrafo, una canción. Después de Shannon, la información queda enteramente abstraída en bits. […] Como los geómetras someten un círculo en la arena y el disco solar a las mismas leyes, y los físicos la oscilación de un péndulo y las órbitas de los planetas a las mismas leyes, Claude Shannon hizo nuestro mundo posible alcanzando la esencia de la información.

Con sus aportaciones en circuitos lógicos, teoría de la información, aprendizaje automático, y otros campos, Claude Shannon «no se molestó en predecir el futuro, tiró hacia delante y lo inventó»[116]. En el mundo de la información, Shannon nos dijo cómo hacer las cosas, cómo calcularlas, cuáles son sus relaciones, y qué es lo que no debemos esperar porque es imposible. Nos dio, en suma, el alfabeto y la gramática básica de la información, las ideas rectoras para conocer su esencia y operar con ella. Aunque A Mathematical Theory of Communication fue en su momento, en términos de Gunther S. Stent [117], un descubrimiento ‘prematuro’, uno cuyas implicaciones no podían conectarse, por una serie de escalones lógicos y simples, con el conocimiento canónico o aceptado por todos [118], hoy es claro que hablar de la influencia de Shannon es «como decir cuánta influencia ha tenido en la literatura el inventor del alfabeto» [119]. Paradójicamente, desde muy pronto la teoría de la información llamó la atención de lingüistas, filósofos, psicólogos, economistas o biólogos, que buscaron imbricarla, en pie de igualdad con el resto de conceptos y herramientas, dentro de sus disciplinas. Ya a mediados de los sesenta hubo unos Coloquios de Royaumont con el significativo título El concepto de información en la ciencia contemporánea, donde, en torno a este concepto que había alcanzado resonancias insospechadas por Shannon, trataron de «ponerse de acuerdo campos tan disímiles como los de la cibernética, la matemática, la biología y aun la historia, la pedagogía y la sociología» [120]. En la misma década el afamado semiólogo, filósofo y novelista Umberto Eco publicaba su Obra abierta, que inauguraba un nuevo enfoque para estudiar la poética contemporánea. En la edición española de esta obra [121] dedica a la Teoría de la Información según Wiener y Shannon una sección de sesenta páginas, donde insiste en distinguir entre el significado de un mensaje y la información contenida en el mismo. Pero esto también lo había dejado claro Shannon: nos dijo de qué estaba hablando cuando hablaba de información, y que en sus fórmulas y algoritmos, que para su problema ingenieril, los aspectos semánticos y los criterios de verdad no eran relevantes.

[93] Horgan, J. (1992). Claude E. Shannon (Profile). IEEE Spectrum, 29(4):72– 75, p. 72.

[94] Horgan, op. cit.

[95] Poe, E. A. (1973). Ensayos y críticas. Alianza, p. 408.

[96] Poe, op. cit., p. 412.

[97] Horgan, op. cit., p. 75.

[98] El esquema conocido como Vernam por Gilbert Vernam quien lo inventó a finales de la Primera Guerra Mundial y que, esencialmente, propone el uso de una clave aleatoria de la misma longitud que el mensaje a transmitir (Shannon, C. E. (1949). Communication Theory of Secrecy Systems. The Bell System Technical Journal, XXVII(3):379–423).

[99] Shannon, C. E. (1950). A Chess–Playing Machine. Scientific American, 182(2):48–51.

[100] Brooks, R. (2022). Claude Shannon Greatest Hits. IEEE Spectrum, February:23.

[101] Shannon, op. cit., p. 51.

[102] Shannon, op. cit., p. 48.

[103] Merece la pena conocer la obra de este ingeniero y matemático español que, además de sus múltiples y extraordinarios inventos, en sus escritos, sobre todo en sus Ensayos sobre Automática, nos dejó algunas ideas que se podrían considerar precursoras de las de los miembros del Ratio Club.

[104] Shannon, C. E. (1940). A symbolic analysis of relay and switching circuits. Master’s thesis, Massachusetts Institute of Technology. Shannon, C. E. (1938). A Symbolic Analysis of Relay and Switching Circuits. AIEE Transactions, 57:713–723.

[105] Horgan, op. cit., p. 72. Al parecer, el japonés Akira Nakashima (1908–1970) escribió una serie de artículos en japonés entre 1934 y 1936 en los que se anticipaba a Shannon, y también se anticiparía el lógico ruso Victor Shestakov (1907–1987), aunque su tesis se publicase al tiempo de la de Shannon y el artículo en 1941, ambos en ruso.

[106] Ferrater Mora en el artículo “Characteristica Universalis” de su Diccionario de Filosofía (Alianza, 1984, Vol. I).

[107] Shannon, C. E. (1948). A Mathematical Theory of Communication. The Bell System Technical Journal, XXVII(3):379–423, p. 379.

[108] Adaptado de: Soni, J. and Goodman, R. (2018). A Mind at Play. Simon & Schuster.

[109] Nyquist, H. (1924). Certain Factors Affecting Telegraph Speed. Transactions AIEE, February:412–422.

[110] Hartley, R. V. L. (1927). Transmission of Information. International Congress of Telegraphy and Telephony, Lake Como, Italy:29pp.

[111] Para esta sección he utilizado, principalmente, lo expuesto en: Lee, E. A. (2017). Plato and the Nerd. The MIT Press; Stewart, I. (2019). 17 ecuaciones que cambiaron el mundo. Crítica; Gleick, J. (2012). La información: historia y realidad. Crítica. Y, por supuesto, el trabajo original de Shannon.

[112] Horgan, op. cit.

[113] Szilard, L. (1964). On the Decrease in Entropy in a Thermodynamic System by the Intervention of Intelligent Beings. Behavioral Science, 9(4):301–310.; Rex, A. (2017). Maxwell’s Demon—A Historical Review. Entropy, 19(240).

[114] En C. M. Bowra, Poesía y canto primitivo, Antoni Bosch, 1984, pp. 22–23.

[115] Soni and Goodman, op. cit.

[116] Según Rodney Brooks.

[117] Stent, G. S. (1987). Las paradojas del progreso. Salvat, p. 89.

[118] De hecho, su teoría no sería plenamente explotada hasta los años 70, con la llegada de los circuitos integrados de alta velocidad (Horgan, op. cit., p. 74).

[119] Horgan, op. cit., p. 74.

[120] Guéroult, M. (1966). El concepto de información en la ciencia moderna [Coloquios de Royaumont]. Siglo XXI.

[121] Umberto Eco (1984), Obra abierta, Ariel.

Vinagre, Blas M. «Antes y después de Shannon». Adyacente posible, 5 de marzo de 2026. https://adyacenteposible.com/2026/03/05/antes-y-despues-de-shannon/.